Capítulo 4 Resultados potenciais

No capítulo passado, vimos que nos permite entender o comportamento de em um cenário distinto dos dados observados. Por exemplo, se é a indicadora de um tratamento e é a indicadora de cura, então nos permite entender a proporção de cura em um cenário hipotético em que administramos o tratamento a todos os indivíduos. Esta distribuição nos permite investigar questões causais que não eram acessíveis usando apenas a distribuição observacional, .

Contudo, algumas perguntas causais não são respondidas utilizando apenas os mecanismos desenvolvidos no capítulo 3. Por exemplo, qual a probabilidade de que um indivíduo se cure quando recebe o tratamento e não se cure quando não o recebe. Quando tentamos traduzir esta questão, notamos que partes dela envolvem e e outras partes envolvem e . Se tentarmos uma tradução ingênua, podemos obter uma expressão como . Contudo, a probabilidade acima não responde à pergunta colocada. Em primeiro lugar, não está definido fazermos as intervenções e na mesma unidade amostral. Além disso, mesmo que a probabilidade estivesse definida, é impossível que o mesmo assuma tanto o valor quanto . Isto é, .

A última constatação nos revela que o modelo no capítulo 3 não tem variáveis suficientes para traduzir a pergunta levantada. Se imaginamos que é possível que um indivíduo se cure ao receber o tratamento e não se cure quando não o recebe, isto ocorre pois as ocorrências de cura em cada cenário hipotético não são logicamente equivalentes. Em outras palavras, é como se houvessem resultados potenciais22 2 Esta é uma tradução livre da expressão “potential outcomes” usada em inglês., e , para indicar a ocorrência de cura em cada cenário considerado. Com o uso destas variáveis, poderíamos escrever .

O objetivo desta seção é incluir este tipo de variável de forma a preservar as ferramentas desenvolvidas no capítulo 3.33 3 Para tal, adotaremos uma construção baseada em Galles1998. Neste quesito, a maior dificuldade será estabelecer a distribuição conjunta entre os resultados potenciais. Para tal, será útil relembrar um lema fundamental em simulação:

Lema 4.1.

Considere que é uma função de densidade acumulada condicional arbitrária e . Se definirmos, , então .

O Lema 4.1 traz várias interpretações que nos serão úteis. A primeira interpretação, de caráter técnico, é que podemos simular de qualquer distribuição multivariada utilizando apenas variáveis i.i.d. e funções determinísticas. Em particular, podemos reescrever um SCM de tal forma que cada vértice, , seja função determinística de seus pais e uma variável de ruído, . Esta abordagem, que está ligada a modelos de equações estruturais, é apresentada nas Definições 4.2 e 4.3.

Definição 4.2.

Seja um grafo causal. O grafo causal estrutural, , é tal que e . Isto é, para cada , adiciona uma nova variável e uma aresta de a .

Definição 4.3.

Seja um CM. O Modelo Estrutural Causal (SCM) para , , é tal que é o grafo causal estrutural de , são independentes segundo e, para cada , existe uma função determinística, , tal que e .

O Exemplo 4.4 ilustra uma forma de obter um SCM em equações estruturais a partir de um SCM com dois vértices.

Exemplo 4.4.

Considere que , e . Neste caso, o grafo estrutural causal é dado por . Além disso, existem várias representações do SCM em equações estruturais. Uma possibilidade é definir que e são i.i.d. e , e .

O Lema 4.1 também permite uma interpretação de caráter mais filosófico. Podemos imaginar que toda variável em um SCM, , é uma função determinística de seus pais e de condições locais não-observadas, . A expressão “condições locais” indica que cada é usada somente para gerar e que as variáveis em são independentes, isto é, não trazem informação umas sobre as outras.

A interpretação acima é usada na definição de resultados potenciais. A ideia principal é que as mesmas funções determínistas e variáveis de ruído locais são usadas para gerar todos os resultados potenciais. A única diferença é que, para cada resultado potencial, o valor das variáveis em que houve intervenção é fixado. Esta definição é compatível com a ideia de que não é possível modificar os ruídos locais por meio da intervenção. Em outras palavras, o resultado potencial é o mais próximo possível do resultado observado sob a restrição que fixamos os valores das variáveis em que houve intervenção.

Definição 4.5.

Seja um CM de grafo causal e o seu SCM. O grafo de resultados potenciais dado por intervenções em , é tal que

Para todo , abreviamos por .

Em palavras, o grafo de resultados potenciais cria uma cópia de para cada possível intervenção, . Além disso, adiciona-se uma aresta de para cada cópia de . Esta construção indica que as mesmas variáveis em geram todos os resultados potenciais. Também, para cada vértice em que houve uma intervenção, , removem-se todas as arestas que apontam para . Esta remoção ocorre porque, quando realizamos uma intervenção em o valor desta variável é fixado e, assim, não é gerado por suas causas em .

Exemplo 4.6.

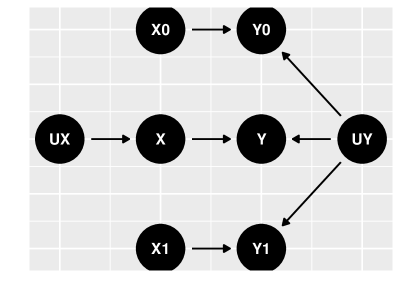

Considere que e o grafo causal é . Vimos no Exemplo 4.4 que o grafo causal estrutural é dado por . Vamos construir o grafo de resultados potenciais dadas intervenções em . Neste caso, além dos vértices , temos também . Como não há ambiguidade neste caso, podemos abreviar os últimos quatro vértices por .

O grafo de resultados potenciais é ilustrado na figur 16. O grafo causal estrutural é a reta horizontal de a . Os resultados potenciais são cópias deste grafo que usam as mesmas variáveis e em que removemos as arestas que apontam para a intervenções, e .

Uma vez definido o grafo de resultados potenciais, podemos extender a distribuição do modelo de equações estruturais para este grafo. Esta extensão envolve três etapas. Primeiramente, a distribuição de continua a mesma. Em segundo lugar, para todo vértice do grafo de resultados potenciais, , em que não houve uma intervenção, este vértice é gerado pelo mesmo mecanismo que . Isto é, . Finalmente, se houve uma intervenção em , então ela é uma variável degenerada no valor desta intervenção. Esta construção é formalizada na Definição 4.7.

Definição 4.7.

Seja um SCM para com funções determinísticas, . O modelo de resultados potenciais (POM)44 4 utilizamos a sigla POM em referência ao termo em inglês “potential outcomes model” dado por intervenções em , é um modelo probabilístico em um DAG, , tal que é o grafo de resultados potenciais dado por intervenções em (Definição 4.5) e

O Exemplo 4.8 ilustra um modelo de resultados potenciais.

Exemplo 4.8.

Considere o SCM em equações estruturais em Exemplo 4.4. Na construção do modelo de resultados potenciais, definimos igualmente a em Exemplo 4.4. Além disso, para cada , e .